Kunstig intelligens (AI) innovation står over for nye udfordringer, efterhånden som virksomheder kappes om at udvikle banebrydende modeller. For nylig har Anthropic, en fremtrædende aktør på AI-landskabet, anklaget tre Kina-baserede AI-firmaer—DeepSeek, Moonshot og MiniMax—for ulovligt at have udnyttet deres avancerede sprogmodel, Claude, til at accelerere udviklingen af egne modeller gennem en teknik kendt som et “destillationsangreb.” Denne afsløring rejser ikke kun problemer omkring tyveri af intellektuel ejendom, men sætter også fokus på bredere geopolitiske og sikkerhedsmæssige bekymringer, der rækker langt ud over tech-branchen.

Forståelse af Destillation: AI-træningens Tveæggede Sværd

Destillation er en udbredt teknik i AI, kendt for sin legitime og kraftfulde anvendelse. Den indebærer, at en mindre eller mindre kapabel model (“eleven”) trænes ved at bruge output fra en mere kapabel model (“læreren”). Gennem denne proces kan organisationer skabe modeller, der bevarer den høje viden og de egenskaber, som deres større modparter har, men som er mere effektive og billigere at implementere.

Ifølge Anthropic anvender førende AI-laboratorier ofte denne teknik for at skabe tilgængelige versioner af deres proprietære modeller til kommercielle kunder. Men metoden kan også misbruges. Når konkurrenter udnytter metodologien ved at generere enorme mængder forespørgsler til en anden virksomheds AI-model og bruger svarene til at træne deres egne systemer, bliver strategien til intellektuel tyveri—ofte kaldet et “destillationsangreb.”

Anthropics Anklager: Omfang og Metoder for de Påståede Destillationsangreb

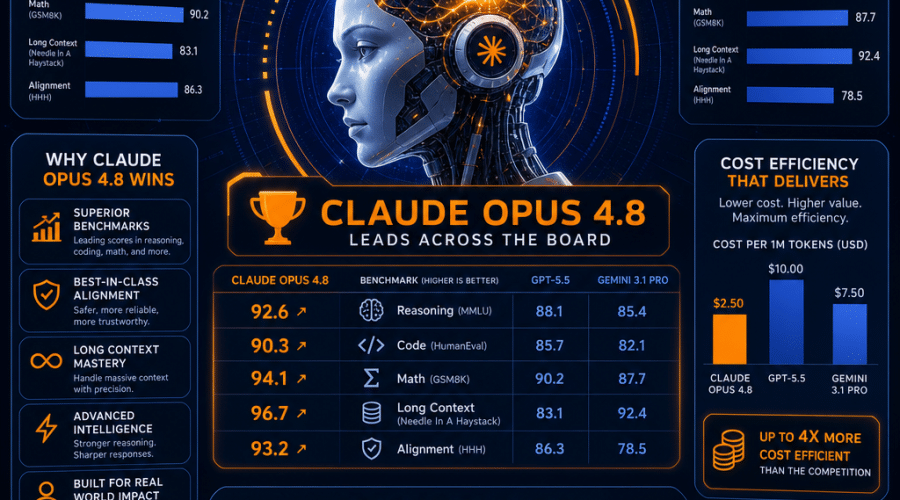

I et detaljeret blogindlæg offentliggjorde Anthropic beviser på, at DeepSeek, Moonshot og MiniMax stod bag storskalakampagner mod deres flagskibsmodel, Claude. Ifølge virksomheden involverede disse handlinger over 16 millioner individuelle interaktioner fordelt på ca. 24.000 falske brugerkonti. Ved at automatisere forespørgsler og indsamle Claudes svar opbyggede de påståede angribere værdifulde data på vigtige områder, der kunne forbedre deres egne modellernes træningsprocesser betydeligt.

Anthropic hævder, at kampagnerne var rettet mod Claudes mest sofistikerede egenskaber: agentisk ræsonnement (modellens evne til autonomt at træffe beslutninger og udføre opgaver), kodning og softwareudvikling, avanceret data-analyse, komplekse rubriceringsopgaver og endda computer vision-opgaver. Dette er områder, hvor banebrydende modeller adskiller sig, og hvor ekspertise er særligt eftertragtet i AI-branchen.

Hvordan Anthropic Identificerede Destillationsangrebene

At opdage svigagtige aktiviteter blandt den normale mængde AI-forespørgsler er ingen let opgave. Anthropics undersøgelse omfattede en grundig analyse med anvendelse af flere tekniske og operationelle indikatorer:

- IP-adressekorrelation: Identifikation af mønstre blandt netværksadresser, hvorfra forespørgslerne stammede.

- Anmodningsmetadata: Analyse af supplerende data forbundet med hver interaktion, såsom tidsstempler og enhedsoplysninger.

- Infrastrukturindikatorer: Opdagelse af karakteristiske tegn på automatisering eller unormalt forbrug, der afviger fra almindelig kundeadfærd.

- Branchebaseret samarbejde: Koordination med andre AI-platforme og partnere for at krydstjekke og bekræfte mistanker.

Denne flerstrengede tilgang gjorde det muligt for Anthropic at tilskrive angrebene til DeepSeek, Moonshot og MiniMax med høj grad af sikkerhed. Alle tre er fremtrædende kinesiske AI-virksomheder med milliardvurderinger. Blandt dem har DeepSeek opnået stigende international opmærksomhed takket være deres konkurrencefordele inden for store sprogmodeller.

Intellektuel Ejendom og Geopolitiske Konsekvenser

Selvom uautoriseret destillation af AI-modeller udgør en alvorlig krænkelse af ophavsrettigheder, understregede Anthropic, at indsatsen er endnu højere. Virksomheden advarede om vidtrækkende nationale sikkerhedsrisici, især når avancerede amerikanske AI-teknologier ubemærket integreres i udenlandske konkurrenters modeller.

“Udenlandske laboratorier, der destillerer amerikanske modeller, kan derefter fodre disse ubeskyttede egenskaber ind i militære, efterretnings- og overvågningssystemer—hvilket gør det muligt for autoritære regeringer at anvende avanceret AI til offensive cyberoperationer, desinformationskampagner og masseovervågning,” udtalte Anthropic.

Sådanne scenarier understreger den sarte balance i krydsfeltet mellem AI-innovation, global konkurrence og offentlig sikkerhed. Efterhånden som AI-systemer bliver mere kraftfulde, vokser bekymringerne for deres brug som våben, manipulation eller misbrug af stats- og ikke-statslige aktører. Reguleringssystemer halter bagefter den teknologiske udvikling, hvilket skaber sårbarheder, som ressourcestærke organisationer kan udnytte.

Et Påtrængende Behov for Styrket Branchesamarbejde og Politisk Respons

Efter at have offentliggjort angrebene fremlagde Anthropic en række tiltag, der skal styrke deres forsvar fremadrettet:

- Forbedring af detektionssystemer: Opgradering af overvågning og analyser for hurtigt at opdage mistænkelige forespørgsler og unormal adfærd.

- Deling af trusselsinformation: Samarbejde med branchekolleger og cloud-tjenesteudbydere for at udveksle oplysninger og styrke den kollektive sikkerhed.

- Strammere adgangskontrol: Streng regulering og kontrol af brugerkonti, herunder især masse- eller automatiseret adgang, for at afskrække onde aktører.

Desuden pegede Anthropic på nødvendigheden af en samlet brancheindsats og understregede, at omfanget og raffinementet af destillationsangreb kræver mere end isolerede tiltag. Teknologivirksomheden opfordrede cloud-udbydere, andre AI-laboratorier og beslutningstagere til at koordinere modforholdsregler, der effektivt kan beskytte intellektuel kapital og sikre et trygt innovationsmiljø for AI.

“Ingen virksomhed kan løse dette alene. Som vi nævnte tidligere, kræver destillationsangreb i dette omfang et koordineret svar på tværs af AI-branchen, cloud-udbydere og myndigheder. Vi offentliggør dette for at gøre beviserne tilgængelige for alle, der har en interesse i udfaldet,” skrev virksomheden.

Stigende Tyveri af AI-modeller: En Udbredt Branchesituation

Anthropics afsløringer står ikke alene i det hastigt udviklende AI-landskab. I takt med at store teknologivirksomheder investerer milliarder i at udvikle stadig større og mere avancerede modeller, er den digitale kampplads blevet udvidet. Modeltyveri—via destillation eller andre metoder—er opstået som en strategisk trussel, der gør det muligt for konkurrenter at springe besværlige og dyre forskningsprocesser over ved at udnytte andres hårdt tilkæmpede fremskridt.

Truslen er særlig udtalt i AI-sektoren, hvor kombinationen af åbne grænseflader, cloud-leveringsmodeller og den indbyggede black-box natur i neurale netværk gør traditionel håndhævelse af ophavsret vanskelig. Den eksplosive vækst i generativ AI, med anvendelser fra virtuelle assistenter og kodegenerering til virksomhedsanalyse, forhøjer kun indsatsen for både udviklere og investorer.

Global AI-konkurrence og Kinesisk Innovation

De kinesiske AI-virksomheders involvering i denne formodede kampagne er særligt bemærkelsesværdig, da landet målrettet forsøger at lukke hullet til Vesten inden for AI-forskning. Med stor støtte fra regeringen har kinesiske tech-virksomheder opnået betydelige fremskridt i udviklingen af store sprogmodeller (LLM’er) og positionerer sig ofte som reelle alternativer til de amerikanske ledede platforme.

Især DeepSeek har opbygget et ry for at udgive stadig mere avancerede LLM’er. Moonshot og MiniMax er mindre kendte uden for Kina, men har stærke bånd til hjemmemarkedet og store tekniske ressourcer. Alle tre virksomheder, med vurderinger i milliardklassen, konkurrerer om at integrere banebrydende funktionalitet i nye forbruger-, erhvervs- og offentlige applikationer.

Fremadrettet: Beskyttelse af AI-innovationens Fremtid

Anthropics oplevelse fungerer som en advarsel til hele AI-sektoren. Med innovationshastigheden stigende har behovet for robust IP-beskyttelse, større gennemsigtighed og ansvarlig AI-udvikling aldrig været mere presserende. Fremadskuende virksomheder må investere ikke blot i deres modellers kernefunktioner, men også i sikkerhed, overvågning og etiske rammer, der beskytter deres opfindelser.

Hændelsen understreger også behovet for international dialog om AI-styring. Selvom konkurrence driver fremskridt, undergraver ureguleret industriel spionage tillid og stabilitet i de globale digitale markeder. Politikere og branchefolk må balancere hensynet til innovation og fair konkurrence, så kunstig intelligens ikke bliver offer for mistroens og gengældelsens klima.

Foreløbig markerer Anthropics proaktive tilgang—ved at afsløre detaljerne om angrebene og opfordre til branchesamarbejde—et afgørende skridt mod at sikre AI’s fælles fremtid. Om branchen og de regulerende myndigheder kan leve op til udfordringen, vil ikke alene afgøre, hvem der leder AI-innovation, men også hvor sikkert, etisk og retfærdigt teknologien bringes i spil for at løse samfundets mest presserende problemer.